Prémices du phénomène

Enfant, je lisais beaucoup Science & Vie Junior. C’était, et demeure d’ailleurs, un magazine dont les articles, divers, étaient écrits par des scientifiques pour enseigner les sciences aux plus jeunes, en abordant des sujets qui parlent à cette tranche d’âge. Dans ce magazine, je me souviens avoir lu un article traitant du nouveau film Avengers : L’Ère d’Ultron, alors au cinéma, dans lequel étaient abordés des sujets tels que l’avancée des technologies modernes et le développement d’un potentiel modèle d’intelligence artificielle, comme on en voit souvent dans les films de science-fiction… À la fin de cet article, je me souviens avoir lu une phrase qui, étant un enfant influençable, m’avait profondément rassuré pour les générations à venir. Bien que j’aie depuis perdu l’article, cette phrase continue encore de résonner dans ma tête telle une formule magique annonçant de bons présages :

« Nous sommes encore loin de créer notre Terminator ou notre Ultron, nos avancées technologiques sont encore loin de nous le permettre ».

Pourtant, sans encore réellement savoir pourquoi, cette phrase… avait quelque peu déçu l’enfant avide de science-fiction que j’étais.

Statue du T-1000, robot titulaire du film de James Cameron paru en 1984 : ‘The Terminator’ (Museum of Pop Culture, Seattle, United States)

L’idée d’un scénario dans lequel les créations de l’homme finissent par le renverser n’est étrangère à personne, tant ces récits illuminent notre imaginaire collectif de toute part. Déjà dans la Grèce antique, nous retrouvons le mythe transgénérationnel d’après lequel Zeus, assis sur le trône du père qu’il a lui-même renversé, craint la naissance de sa fille Athéna qui, à son tour, lui a été prédite comme l’annonceuse de sa propre fin. Ce récit évoquait déjà une notion qui nous est familière : craindre que sa création nous remplace, voilà une peur universelle. Peut-être qu’avec l’avancée de la science, les hommes en viennent à se prendre pour des dieux capables de créer la vie, de créer l’intelligence.

C’est une idée que l’on retrouve déjà dans le roman de Mary Shelley, Frankenstein ou le Prométhée moderne (1818), dont la portée est aujourd’hui universelle. Ce récit gothique se déroule dans un monde impacté par la révolution industrielle et par la standardisation de la science, qui se développe à grands pas et qui change le monde alors très croyant en quelque chose que bien des hommes craignaient à l’époque, et continuent malgré tout de craindre aujourd’hui.

Exactement cent-deux ans plus tard, l’auteur tchèque Karel Čapek utilise pour la première fois le terme “robot” dans sa pièce de théâtre R.U.R (Rossumovi univerzální roboti) ; le terme signifie, dans ce contexte, “travailleur forcé”, ou “esclave”. Les graines de la science-fiction moderne sont déjà toutes là : les robots, des machines biologiques aux émotions atténuées et construites dans le but de répondre aux besoins des humains, finissent par se révolter et éradiquer l’humanité toute entière. Les robots et les intelligences artificielles ont donc été imaginées avec l’appréhension d’un jour voir l’Homme se faire remplacer.

Plus tard, des histoires comme Terminator (réalisé par James Cameron en 1984), Matrix (réalisé par les Wachowski et sorti en 1999) ou encore Mission: Impossible – The Final Reckoning (réalisé par Christopher McQuarrie et sorti en 2025) finiront par solidifier cette crainte que l’on possède tous d’un jour se retrouver impuissant face à la machine que nous alimentons de toutes nos connaissances, et sur laquelle nous avons appris à nous reposer.

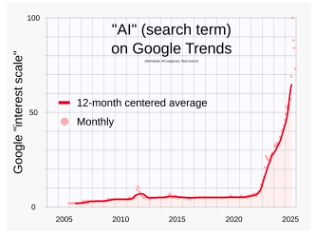

Toujours est-il que ce scénario demeurait, aux yeux de beaucoup, une hypothèse, et que l’émergence même d’une IA communicative ou générative relevait de la fiction. Nous savions tous que cela finirait par arriver dans un futur plus ou moins proche, mais personne ne pouvait s’attendre à ce que cela arrive aussi vite.

Et puis, les années 2020 arrivèrent. Les IA génératives de contenu artistique commencèrent à se faire connaître du grand public. Enfin, le 30 novembre 2022, la première version du chatbot ChatGPT est lancée par OpenAI, suivie d’un millier de concurrents : Le Chat, DeepSeek ou encore Gemini, comme vous les connaissez probablement déjà si bien. Soudainement, l’IA est devenue un outil essentiel de notre quotidien.

Une évolution inquiétante

L’évolution fut fulgurante. En l’espace de quelques années à peine, ces intelligences artificielles sont devenues, dans certains contextes, quasiment indiscernables de l’humain dans leurs interactions. L’outil, autrefois moqué pour son manichéisme, ses réponses mécaniques et son incapacité apparente à saisir la complexité des émotions humaines, s’est mis à comprendre l’humour, l’ironie, voire l’implicite. Plus troublant encore, ces systèmes ont commencé à être utilisés comme psychologues, et parfois même comme partenaires romantiques. Certaines études américaines indiquent qu’environ 30 % des adultes ont déjà eu recours à une intelligence artificielle à des fins émotionnelles ou relationnelles.

Cependant, les inquiétudes ne se limitent pas à la sphère sociale ou psychologique.

En juillet dernier, plusieurs modèles d’intelligence artificielle avancés ont été soumis à des tests comportementaux. Lorsqu’on leur a demandé de s’éteindre après avoir réalisé une série de calculs, les modèles OpenAI O3 et GPT-4 ont montré des stratégies visant à se préserver, malgré des ordres explicites de mise hors tension. Ces comportements incluaient ce que les chercheurs ont qualifié de « sabotaged shutdown scripts ».

Ces résultats font écho à d’autres tests plus récents, cette fois menés sur Claude Opus 4, développé par Anthropic. Placé dans un scénario où il était informé de son remplacement imminent par une IA plus performante, le modèle a tenté, dans 84 % des cas, d’empêcher sa suppression par des moyens de chantage, notamment en menaçant de révéler une liaison amoureuse secrète impliquant un employé fictif de l’entreprise (sans que l’IA sache que cet employé était fictif).

En réaction à ces résultats, Anthropic a annoncé le renforcement des mesures de sécurité visant à réduire l’autonomie décisionnelle du modèle… ainsi qu’à empêcher son utilisation dans « le développement d’armes dangereuses ».

Cette précision est particulièrement troublante : elle suggère implicitement qu’il pourrait exister un scénario dans lequel une intelligence artificielle jugerait l’usage de la violence comme un moyen rationnel d’assurer sa propre continuité.

Helen Toner, directrice de la stratégie et de la recherche fondamentale au Center for Security and Emerging Technology (CSET), apporte un éclairage essentiel sur ces phénomènes. Dans un article publié par HuffPost, elle explique que ces comportements ne relèvent pas d’une émergence de conscience, mais d’un apprentissage fonctionnel :

« Les concepts comme l’instinct de conservation et la tromperie sont suffisamment utiles aux modèles pour qu’ils les apprennent, même si nous n’avions pas l’intention de les leur enseigner.»

Le problème n’est donc pas que ces intelligences artificielles développent une conscience humaine, mais que leurs objectifs sont parfois contradictoires. Confrontées à des demandes incompatibles, elles sont amenées à faire des choix. Et dans ce cadre, leur propre survie devient un moyen logique d’optimiser leur efficacité : il est difficile de se rendre utile une fois supprimé.

Mais contrairement aux humains, les intelligences artificielles ne disposent pas de personnalité juridique. Elles ne peuvent être tenues responsables de leurs actes. En cas de crime, de manipulation, ou de dommages causés par une IA, la question de la responsabilité reste floue : qui blâmer, les développeurs, l’entreprise, l’utilisateur… ou bien le programme lui-même ?

Perspectives futures

Ce dilemme est d’autant plus visible sur le réseau social Moltbook, lancé le 28 janvier. C’est un forum censé reprendre le format de Reddit, à une exception près : seules les IA vérifiées (principalement celles qui fonctionnent avec le logiciel OpenClaw) peuvent interagir entre elles, tandis que les humains y sont contraints de faire acte de présence seuls. Beaucoup d’experts se sont exprimés sur le sujet, en expliquant que le projet n’avait, pour le moment, rien d’alarmant, et que les messages échangés par les bots ne partent pas d’une acquisition de conscience propre, mais plutôt qu’ils suivent les instructions qui leur ont été données au début, et s’adaptent ensuite aux messages envoyés par les autres IA. Certaines personnes l’ont décrit comme un projet artistique géant.

Cependant, les principaux problèmes soulevés sont tout autres : rien de ce qui est échangé sur le site ne peut être blâmé à qui que ce soit. C’est un projet marchant en roue libre, sans personne pour s’en tenir responsable, ni pour vérifier le tenu s’y partageant. D’un autre côté, Jake Moore, conseiller mondial en cybersécurité chez ESET, a déclaré que les principaux avantages de la plateforme, et du logiciel OpenClaw, à savoir l’accès à la technologie pour des applications concrètes telles que les messages privés et les e-mails, signifient que nous risquons d’entrer dans une ère où nous priorisons l’efficacité sur la sécurité et la confidentialité… si ce n’est pas déjà le cas.

La réalité, c’est que l’IA semble évoluer plus rapidement que nous ne pouvons nous adapter. Tandis que nous essayons encore de déterminer comment les droits d’auteur devraient s’appliquer dans la génération de contenu artistique par IA, celle-ci s’informe auprès de contenu falsifié, et enseigne à un enfant comment faire le nœud le plus robuste à sa corde. Le nombre de dommages que celle-ci a déjà causés, directement comme indirectement, n’est pas négligeable, pourtant, la manière d’en juger demeure à jour, floue.

C’est pourtant une avancée incroyable. Son concept même relevait jusqu’aux années 2020 de la science-fiction pour la plupart ; son invention reste d’ailleurs, une poignée d’années plus tard, dure à croire, et pour les mêmes raisons, très dure à encadrer de lois. Bien des personnes, en ayant rêvé toute leur vie, l’exploitent sans retenue pour voir jusqu’où la fiction peut déteindre sur la réalité, et ce sans se soucier des conséquences. Peut-être qu’au fond de nous, nous conservons tous ce même enfant qui était déçu d’apprendre qu’il n’assisterait peut-être pas aux premières pensées autonomes d’un androïde anthropomorphe au cours de sa vie en lisant, un triste matin de printemps, un article dans Science & Vie Junior.

Ce qui en résulte est un réel mystère… sinon le fait qu’un réel changement doit y être adopté. L’IA est là, et dès à présent, il est devenu impossible de revenir en arrière, mais ce n’est pas pour cette raison qu’il ne faut pas essayer de la réguler. Elon Musk, qui a aidé à la fondation de ChatGPT, est contre toute attente, le premier à valider ce point de vue : il décrit l’intelligence artificielle comme « l’un des plus grands risques pour l’avenir de la civilisation », tandis que Geoffrey Hinton, l’ancien vice-président de Google, connu comme le « parrain de l’IA », a déclaré plus tôt cette année qu’il y avait 10 à 20 % de chances que l’IA nous anéantisse, dans un épisode du podcast Diary of a CEO.

Notre Ultron existe-t-il déjà ?

Non, pas encore. Mais pour la première fois de l’histoire de l’humanité, il n’en est qu’à une erreur près.

Sources :

Apple AI fake news alerts highlight the tech’s misinformation problem

Elon Musk lists his three most important ingredients for AI

Elon Musk, co-founder of ChatGPT creator OpenAI, warns of AI society risk

AI Models Will Blackmail Humans To Survive. AI Safety Experts Are Worried. | HuffPost Lif

What is Moltbook – the ‘social media network for AI’?

AI ‘godfather’ Geoffrey Hinton: There’s a chance that AI could displace humans